Drama và review thực tế từ anh em Hacker News về việc bế Qwen 3.5 về chạy offline. Ép xung phần cứng, nhồi nhét VRAM và những pha lú não vì GGUF.

Dạo này giang hồ đang kháo nhau rần rần vụ bế con AI xịn xò về chạy ngay trên máy ở nhà. Đ*o cần nạp VIP cho mấy pháp sư OpenAI hay Anthropic, anh em hoàn toàn có thể tự thẩm Qwen 3.5 ngay trên cái dàn PC ghẻ của mình.

Mới đây, Unsloth tung ra bộ tài liệu hướng dẫn chạy local Qwen 3.5, và ngay lập tức cái topic này leo rank ầm ầm trên Hacker News. Thay vì phải cúng tiền subcription hàng tháng, giờ đây anh em dev đang thi nhau ép xung con card màn hình cùi bắp ở nhà để tự chạy AI. Điều ảo ma nhất là Qwen 3.5 tỏ ra quá bá đạo trên các dòng phần cứng dân dụng. Từ việc code dạo, OCR, cho đến làm trợ lý ảo, con hàng này đang khiến nhiều pháp sư phải quay xe, suy nghĩ lại về việc có nên tiếp tục xài API online hay không.

Dạo một vòng comment, có thể thấy các đồng đạo đang chia làm mấy hệ phái test máy cực kỳ ma giáo:

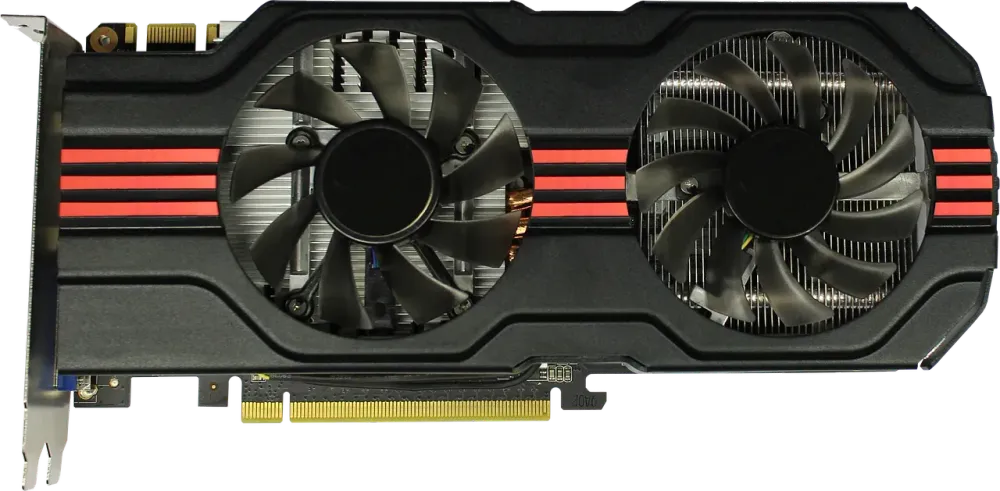

1. Phái "Đỗ nghèo khỉ" nhưng thích đú: Một lão quái có nick Twirrim thề thốt rằng lão đang chạy bản 35B-A3B trên con card RTX 3050 (8GB VRAM) mà vẫn mượt mà, gánh task code ầm ầm. Thậm chí có thanh niên xài đồ cổ 1660 Ti 6GB VRAM, vọc vạch CachyOS kẹp với llama.cpp-cuda, vẫn ép nó chạy được bản 35B. Cảm giác vắt kiệt từng MB VRAM nó phê chữ ê kéo dài anh em ạ.

2. Phái "Bơi trong VRAM": Mấy đại gia sở hữu GPU 16GB (như 4070ti hay 4080) thì kẹp LM Studio chạy bản 9B, bú phát ~100 tokens/giây. Tốc độ này ăn đứt mấy cái service API lùa gà trên mạng. Đặc biệt, có cao nhân còn nhét vừa bản 27B quantize (ép kiểu 4-bit) vào con card 16GB, và claim rằng chất lượng output ngang ngửa Claude Sonnet. Khét lẹt!

3. Phái "Tẩu hỏa nhập ma" vì định dạng: Đây là hệ quả của việc có quá nhiều chuẩn nén. Một loạt anh em đang kêu trời vì cái bảng chữ cái quái quỷ của định dạng GGUF (IQ4_XS, Q4_K_M, UD-Q4_K_XL...). Đọc xong đ*o hiểu phải tải file nào cho hợp với cái Mac Mini M4 ở nhà. Việc thiếu một cái bảng mapping chuẩn giữa "Phần cứng - Model - Config" đang làm dân tình lú lẫn.

4. Phái "Thực dụng phần cứng": Nhiều ông chốt hạ luôn: PC Gaming thì hợp để chạy model cỏ. Apple Silicon (Mac M-series) là chân ái để cõng mấy model bự mà không sợ cháy nhà. Còn nếu tiền không thành vấn đề? Cứ táng Nvidia. Bí quá đ*o có card thì thuê mịa một con máy chủ cloud mà vọc cho lẹ.

Rõ ràng kỷ nguyên Local LLM đang vả đôm đốp vào mặt mấy dịch vụ cloud AI đắt đỏ. Qwen 3.5 chứng minh rằng anh em dev hoàn toàn có thể sở hữu một con đệ tử AI code dạo chạy offline với chi phí cực rẻ.

Nhưng mà khoan vội gáy. Việc nhét một con AI to chà bá vào phần cứng yếu bắt buộc phải qua nhào nặn (quantization), đồng nghĩa với việc nó sẽ ngu đi một chút và thi thoảng vẫn "ngáo đá" (hallucinate). Bài học ở đây là: Dùng nó để pair-programming thì tuyệt vời, nhưng nhắm mắt copy-paste code của nó mà đ*o review thì có ngày sập server, hotfix ốm đòn nhé các đạo hữu!

Nguồn hóng hớt: Hacker News - How to run Qwen 3.5 locally