Anh em tò mò muốn kéo LLM về chạy offline cho ngầu? Check ngay con tool canirun.ai xem máy mình có đủ sức hay bốc khói nhé. Giang cư mận đang combat nảy lửa!

Dạo này lướt sảnh nào cũng thấy các pháp sư công nghệ hô hào "Local AI is the future", xúi anh em kéo LLM về chạy offline cho nó bảo mật, không bị khóa mõm như xài ChatGPT. Nghe thì xịn xò con bò đấy, cho đến khi bạn nhận ra con AI nó cắn RAM với VRAM tàn bạo đến mức nào.

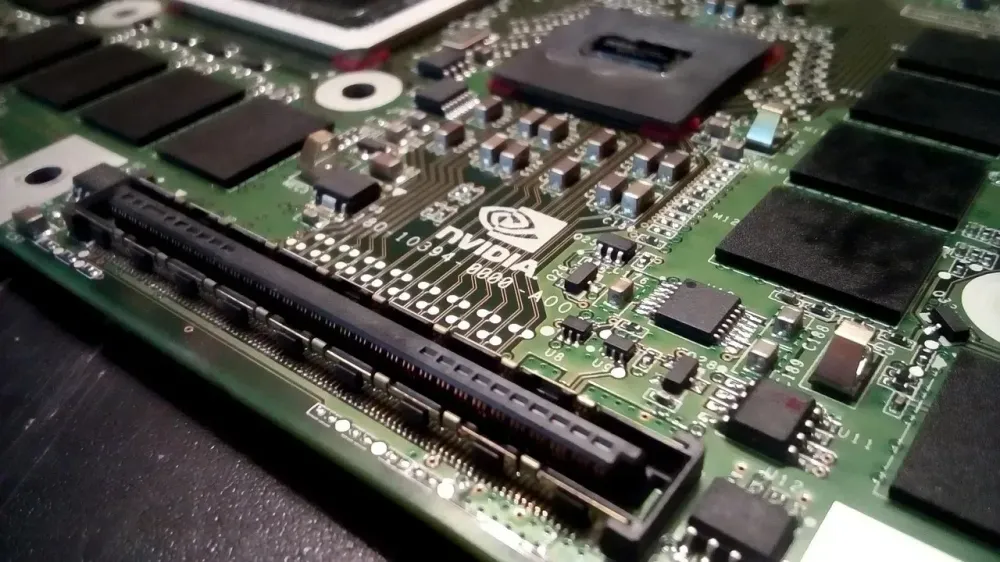

Nói vuông cho nó nhanh, trang web canirun.ai (đang chễm chệ gần 1000 upvote trên Hacker News) chính là phiên bản "Can You Run It" nhưng dành cho hệ sinh thái AI.

Anh em nào hồi xưa hay tải game crack chắc lạ gì cái trò check cấu hình xem máy có gánh nổi GTA V hay Cyberpunk không. Giờ thì thay game bằng Llama 3, Mistral, hay Phi-3. Bạn chỉ cần ném thông số CPU, RAM, GPU của máy bạn vào, web sẽ phán ngay một câu xanh rờn: Chạy mượt, chạy giật tung chảo, hay là chạy xong thì đi mua card màn hình mới. Nó tính toán dựa trên lượng VRAM (Video RAM) cần thiết để load model và tốc độ inference (tokens per second).

Lướt qua các luồng comment trên HN, cộng đồng đang chia phe combat cực kỳ gắt gao. Tựu trung lại có mấy luồng tư tưởng ma giáo sau đây:

1. Hội "Trái táo cắn dở" ngạo nghễ: Từ ngày Apple ra chip M-series với kiến trúc Unified Memory (RAM với VRAM dùng chung), mấy đạo hữu xài Mac bỗng nhiên trở thành chân ái của làng Local AI. "Cầm con Mac Studio 128GB RAM chạy Llama 70B mượt như sunsilk anh em ạ". Ảo ma thật sự, vì để có 128GB VRAM bên thế giới PC, bạn phải bán cả sổ đỏ để mua một dàn card Nvidia.

2. PC Master Race khóc ròng vì "Thuế Nvidia": Anh em dùng PC thì đang chửi rủa chính sách hút máu của Jensen Huang. Card chơi game thì VRAM bèo bọt (16GB - 24GB là kịch kim), mua được cái card 24GB VRAM thì cũng bay mẹ tháng lương. Kéo mấy model nhỏ 8B thì mượt, chứ đụng đến hàng 70B thì PC auto sập server, văng miểng tắt thở.

3. Hội thực dụng "Thuê cụ nó cho nhanh": Một số lão quái thì vỗ đùi đánh đét: "Tội quái gì phải khổ?". Build dàn máy trăm củ về chỉ để chat linh tinh thì thà quăng mẹ nó lên máy chủ cloud mà chạy cho mát máy. Cần thì xài API, hoặc dùng luôn các ai tools có sẵn, làm việc cho nó lẹ, hơi đâu đi làm khổ dâm.

Tóm cái váy lại, cái trang canirun.ai này là một cú vả thực tế cực mạnh cho những anh em đang mơ mộng ảo tưởng sức mạnh về máy tính cá nhân.

Chốt hạ: Nếu anh em định dấn thân vào con đường "tự cung tự cấp" AI, hãy xác định rõ mục tiêu. Thích vọc vạch, phá phách, học hỏi architecture? Triển luôn! Tải Ollama hoặc LM Studio về mà nghịch, cháy card thì đền. Nhưng nếu anh em cần deploy app ra tiền, cần phục vụ user, thì dẹp cái sĩ diện "Self-hosted" đi. Tiền điện và tiền mua GPU còn đắt hơn tiền bạn dùng Cloud API của OpenAI hay Anthropic gấp trăm lần. Hãy làm dev thông minh, đừng làm dev khổ dâm!

Nguồn hóng hớt: